Data Integration &

Data Engineering

Entwicklung, Modernisierung und Optimierung Ihrer

DWH- und BI-Infrastruktur auf Basis von IBM,

Informatica und Microsoft

Die neue Herausforderung: Effektives Datenmanagement

Business Intelligence in den hochregulierten Branchen der Finanzindustrie muss ganz besondere Anforderungen erfüllen: Vollständigkeit, Qualität, Ausfallsicherheit und Schnelligkeit.

Bisher erfüllen die bewährten und hoch-robusten Technologien von IBM und Informatica diese Anforderungen. Das explodierenden Datenvolumen und die kontinuierliche Digitalisierung der Prozesse, erfordert aber Anpassungen und Modernisierungen dieser Technologien.

Single Point of Truth

Der „Single Point of Truth“, also die vollständige und korrekte Erfassung aller relevanten Daten, ist für Banken und Versicherungen ein zentrales BI-Kriterium. Die modernen und zugleich bewährten DWH-Technologien können diesen Anspruch erfüllen, auch weil mit ETL / ELT unterschiedliche Möglichkeiten existieren, Daten aus verteilten und heterogenen Datenquellen zu integrieren und so eine konsistente Analyse ermöglichen.

Sicher und Verfügbar

Die Integration und Bereitstellung von verteilten Daten aus Hybrid- und Intercloud-Umgebungen erfordert nicht nur eine technologische Interoperabilität (z.B. ETL, ELT, CDC und Streaming), sondern stellt auch neue Anforderungen an die DWH-Automatisierung. Neue Ansätze auf Basis von Data Vault oder Cloud Native erreichen hier eine sichere, vollständige und vor allem parallele (schnelle) Beladung des Datenprozesses.

Flexibilität und Skalierung

Die Migration oder Erweiterung des klassischen „on premis“ DWH in die Cloud ermöglichen es, auf das exponentielle Wachstum des Datenvolumens zu reagieren. Mittels „Cloud Data Warehousing“ ist die flexible, horizontale Skalierung möglich. Grundlage ist allerdings eine fundierte Kosten-Analyse, denn nicht immer ist eine Migration in die Cloud auch mit Kosteneinsparungen verbunden.

Use Case

Versicherung

Entwicklung und Realisierung eines Enterprise DWH als zentrale Grundlage für das Business Intelligence

Situation:

Konsolidierung der Datenstruktur eines Versicherungskonzerns durch Schaffung eines Enterprise DWH (EDWH) als zentrale und strategische Basis für das Reporting über alle Sparten und über verschiedene Marken.

Was wir tun

Entwicklung, Optimierung und Modernisierung

von DWH-Architekturen

Wir unterstützen Sie durch zertifizierte und anerkannte Experten und durch unser

umfangreiches Know-how bei der Umsetzung von DWH- und Data Lake Architekturen

Konzeption

Gemeinsame Entwicklung der

System-Architektur:

- Fachliche und technische Anforderungen

- Bestehende Restriktionen

- Architektur/ Modeling

- Schätzung der Anpassungs- und Entwicklungsaufwände

- Roadmap für die Realisierung

Data Integration

Anbindung und Bereitstellung

von Datenquellen:

- Definition der Datenquellen

- Data Preparation

- Data Migration / Data Integration (ETL)

- Testing

- Optimierung / Qualitätsprüfung

Data Governance

Qualität und Sicherheit des Schutzes der System-Architektur:

- „Data Ownership“

- Zugriffsrechte

- ETL-basierte Data Quality Prozesse

- Data Quality durch Profiling im DWH / Data Lake

- Data Lineage / Data Impact

- Historisierung

Optimierung

Verbesserung von Stabilität

und Performance:

- Review von System und Prozessen (Health Checks)

- Performance Optimierung

- Anpassung / Integration neuer Anforderungen

- Incident Management

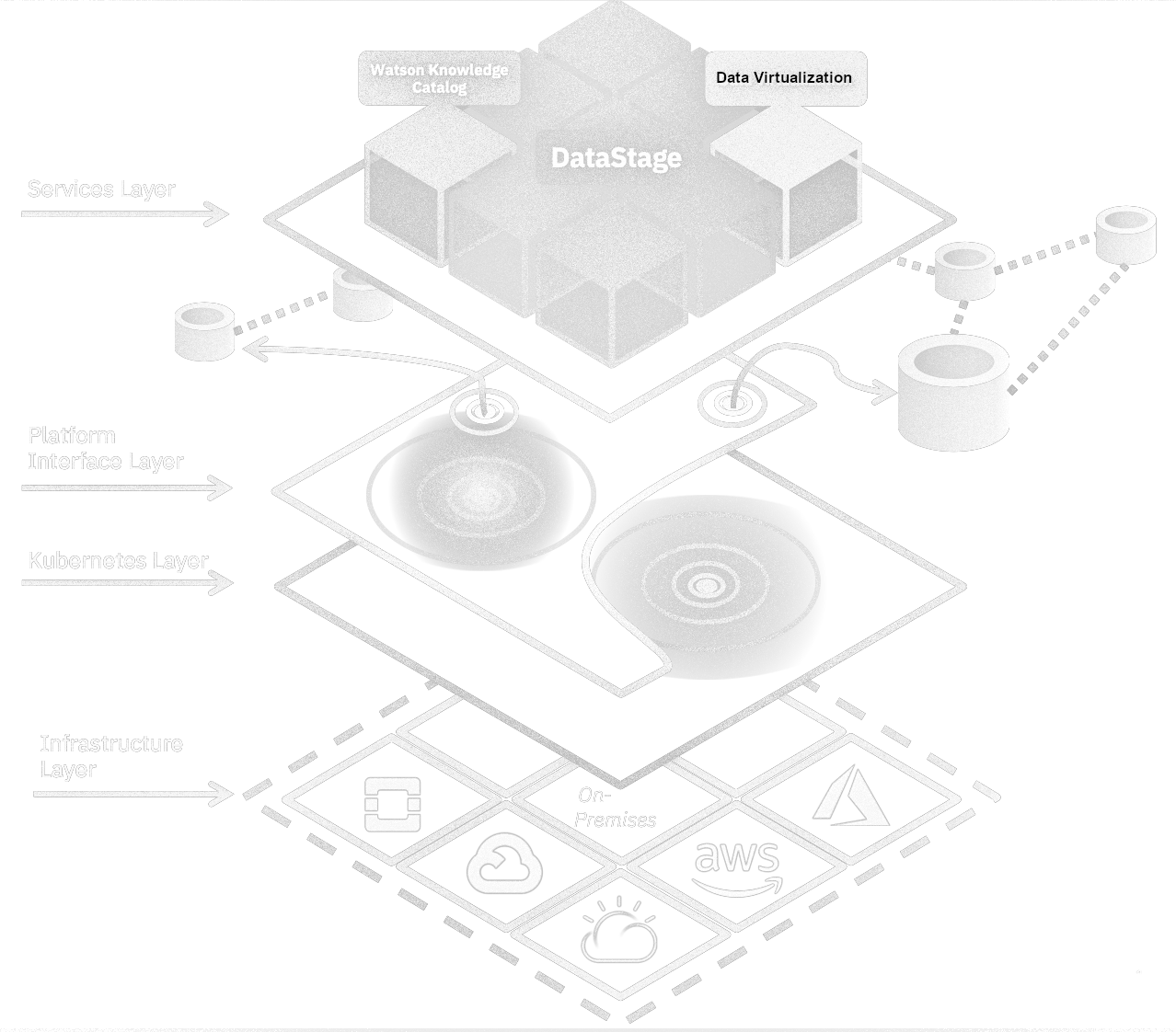

IBM Cloud Pak® for

Data (DataStage)

Das explosive Wachstum des Datenvolumens erhöht auch immer stärker den Zeit- und Kostenaufwand für die Data-Maintenance. Aus diesem Grund hat IBM mit der Entwicklung der Cloud-basierten Lösung IBM Cloud Pak® for Data begonnen.

Cloud Pak for Data wird eine verbesserte Skalierbarkeit und Elastizität für unterschiedliche Workloads bieten, wodurch sich die Betriebskosten senken werden.

Gleichzeitig können momentan noch parallel laufende Cloud-Data-Warehouses, analytische Echtzeitanwendungen, auch mit den unterschiedlichsten Datenformate, in das System integriert werden.

Aktuelle Entwicklungen über IBM Cloud Pak® for Data (DataStage) können Sie hier finden: DataStage Usergroup.

Zusammen mit unserer Expertise auf den Gebieten Anforderungsanalyse, Architektur/ Modeling, Data Preparation und Data Migration entstehen so robuste und hoch performante ETL-Prozesse.

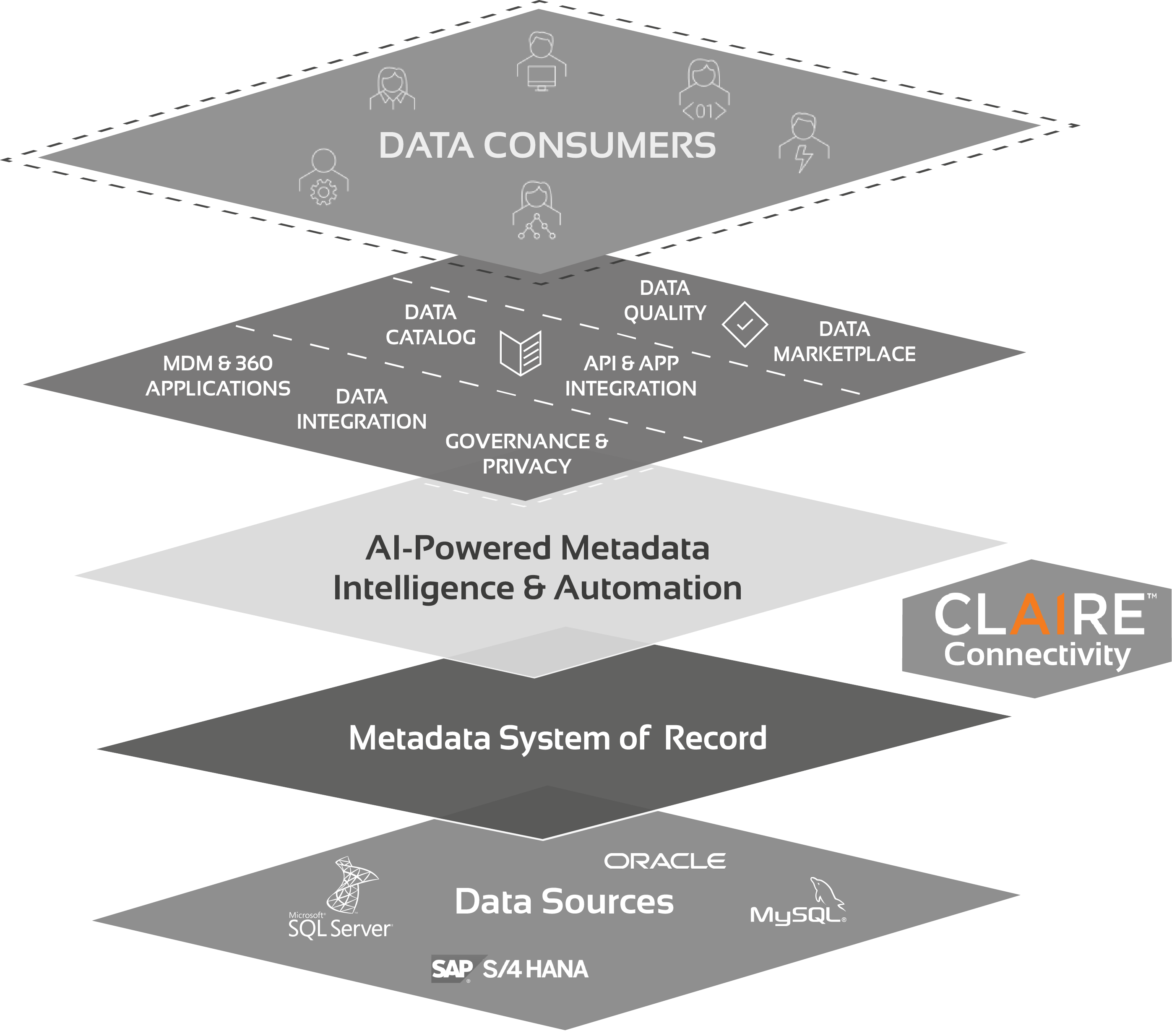

Informatica Intelligent Cloud Services® (IICS)

IICS ist die Weiterentwicklung der bewährten ETL-Suite Informatica PowerCenter® von Informatica, die es ermöglicht, auch Daten aus Multi-Cloud- und Hybrid-Cloud-Systemen zu integrieren.

Dabei ist IICS als offenes und Microservices-basiertes System hochflexibel und verarbeitet Daten aus den unterschiedlichsten Quellen. Wesentlicher Bestandteil ist die API-gesteuerte und KI-gestützte Enterprise Integration Platform as a Service (eiPaaS) sowie die

Informatica Intelligent Migration Factory®, die sich jeweils an den Best Practices von Informatica PowerCenter® orientieren.

Technologien von IBM und Informatica

Methoden

DWH Architekturen | Business Intelligence |

Data Governance | Modellierung | ETL | Migration | Testing | Hybride Architekturen | Streaming Architekturen |

Open Source | SCRUM

Hersteller / Zertifizierungen

IBM | Informatica | Microsoft | Oracle | Snowflake | LINUX | Cloudera

Software

Data Engineering

heißt für uns:

Konzentration auf die etablierten ETL-Suiten von IBM und Informatica, die bei unseren Kunden aus der Finanzindustrie für das Business Intelligence und die Regulatorik genutzt werden.

Durch unser langjähriges Technik- und Branchen Know-how können wir deshalb sehr schnell evaluieren, ob Sie Ihre aktuellen und zukünftigen Ziele mit Ihrer bestehenden Architektur / Technologie erreichen können.

Je nachdem entscheiden wir dann gemeinsam, wie die Modernisierung und Transformation z.B. durch die Nutzung von Cloud Native Technologien aussehen kann.

René Schiebeck

Geschäftsführer & Head of Data Engineering